Как расследовать алгоритмы социальных сетей: пособие GIJN

Влияние алгоритмов социальных сетей многогранно: алгоритмически управляемые новостные ленты угрожают дестабилизации стран и правительств по всему миру, влияют на психическое здоровье и разрушают отношения людей.

Иллюстрация: Ноджадонг Бунпрассерт для GIJN

Вот лишь несколько показательных примеров:

- Теневая блокировка контента пропалестинских аккаунтов.

- Российская кампания влияния для раздувания политической нестабильности в Гане.

- Консервативная мать рассорилась с либеральной дочерью, когда общение в соцсетях углубило пропасть между их политическими взглядами.

Освещать работу алгоритмов социальных сетей можно по-разному. Некоторые подходы нуждаются в неделях работы и навыках цифровой криминалистики и программирования. Однако многие расследования можно проводить с минимальными техническими знаниями или даже без них — просто отслеживать контент в разных аккаунтах или проводить эксперименты на социальных платформах, чтобы показать, какой вред алгоритмы могут наносить пользователям.

Какой бы подход вы ни выбрали, для создания журналистских материалов о последствиях работы алгоритмов социальных сетей нужна определённая изобретательность. Это в значительной степени связано с тем, что частные компании, например, Meta или TikTok, не обязаны раскрывать, как именно они строят свои алгоритмы. Если не принимать во внимание единичные утечки документов, большинству журналистов приходится прибегать к обратному инжинирингу алгоритмов или доказывать, что продвижение ими распространяющего ненависть или дезинформацию контента наносит ущерб.

Первоначально этот материал был опубликован Глобальной сетью журналистов-расследователей и перепечатывается здесь с ее разрешения. Произведение защищено лицензией Международная лицензия Creative Commons Attribution-NoDerivatives 4.0.

Что такое алгоритмы, и как они работают?

Алгоритмы — это наборы правил или вычислений, созданные для выполнения определённой задачи. В сфере социальных сетей алгоритмы оценивают входящие данные — информацию о том, какой контент понравился пользователю, кто входит в круг его контактов на платформе или с какими публикациями он взаимодействовал. Это позволяет определить, какую информацию пользователь увидит в своей новостной ленте, истории публикаций или видеотрансляции, и предсказать, какой контент, вероятнее всего, обеспечит его вовлечённость.

Корпоративные владельцы постоянно меняют эти алгоритмы, поэтому со временем они становятся все более совершенными. Например, алгоритм Facebook обрабатывал около 10 000 сигналов, чтобы предсказать, с какими видами сообщений пользователь, скорее всего, будет взаимодействовать, рассказали в статье 2021 года журналисты The Washington Post.

В 2021 году The Washington Post расследовал, как Facebook изменял свои алгоритмы, и как эти изменения повлияли на ленты пользователей. Изображение: скриншот, The Washington Post

Алгоритмы социальных сетей чрезвычайно сложны, а компании-разработчики не спешат объяснять, как они работают. Следовательно, расследуя ответственность платформ, журналисты сосредотачиваются преимущественно на вредных последствиях работы алгоритмов. В частности, можно анализировать, какой контент становится вирусным на платформах, понимая, какие видеоролики они показывают определённым уязвимым группам населения. Также репортёры могут создавать фиктивные аккаунты для тестирования алгоритмов, изучать распространение на платформе троллинга (преднамеренных попыток спровоцировать или «затравить» кого-то оскорбительными или провокационными сообщениями) и ложной информации.

Освещение тем, связанных с социальными сетями также предусматривает обсуждение информационного потока. В ходе расследований в этой сфере полезно разработать общую терминологию, поскольку многие явления, которые мы наблюдаем в интернете, уникальны именно для социальных сетей.

Дезинформация, мизинформация, язык вражды в соцсетях: что это, и как они распространяются?

Есть множество ресурсов, которые могут послужить журналистам для анализа информационного потока в интернете — например, глоссарий дезинформации, созданный некоммерческой исследовательской организацией EU DisinfoLab. Наиболее популярны в публичном дискурсе три термина: мизинформация, дезинформация и онлайн-ненависть (часто употребляется как синоним к выражению «язык вражды» — прим.редактора).

Мизинформация. Этот термин часто используют обобщённо — для описания самых разнообразных проблем в интернете. На самом деле, его значение значительно уже: мизинформация — это информация, которая является неправдивой, но часто воспринимается как достоверная теми, кто ею делится и распространяет. Например, во время событий, разворачивающихся в реальном времени, люди могут ошибочно делиться фотографиями с другого или давно минувшего события, считая, что эти снимки касаются последних новостей.

Дезинформация — это ложная информация, намеренно созданная или распространённая для введения в заблуждение или причинения вреда. Например, во время президентских выборов в США 2016 комитеты по разведке Сената и Палаты представителей США совместно с Facebook провели расследование, которое установило: российские агенты выдавали себя за американских избирателей и распространяли дезинформацию о фейковых протестах, чтобы углубить политический раскол. Россия до сих пор отрицает всякую причастность к вмешательству в американские выборы.

Разжигание ненависти — ещё один важный вид вредной информации, которую часто распространяют в интернете. Язык вражды подстрекает к насилию против отдельных групп людей на основании их характеристик — расы, религии, пола или сексуальной ориентации. К примеру, политические лидеры Мьянмы использовали Facebook для дегуманизации и демонизации мусульманского этнического меньшинства рохинджа. Это привело к насилию против этой группы. В ответ на отчёт Организации Объединенных Наций Facebook заблокировал 20 организаций и лиц в Мьянме, чтобы остановить распространение ненависти и дезинформацию. Военные чиновники Мьянмы отрицали выводы отчёта ООН.

Журналистам также важно понимать, кто основные игроки в любой медиаэкосистеме. Алгоритмы создают персонализированные онлайн-опыты — каждый из нас живет в собственной уникальной маленькой информационной вселенной, которую ещё называют «эхокамерой» или «пузырём».

Элементы медиаэкосистемы:

- Аудитория – преимущественно пассивные пользователи, которые являются частью этой экосистемы и могут делиться контентом, но не обязательно создают его в больших объёмах.

- Создатели контента, активно производящие много информации. Они, как правило, оказывают значительное влияние на то, какую информацию потребляет аудитория. Среди них могут быть государственные органы, медиа и инфлюэнсеры, а также злоумышленники, пытающиеся сеять раздор.

- Алгоритмы — своеобразный набор правил на основе данных, определяющий, какой контент будет отображаться в лентах пользователей. Именно алгоритмы помогают формировать опыт в этих медиаэкосистемах.

Три подхода к исследованию алгоритмов социальных медиа

Несколько лет назад мы с журналисткой Джейн Литвиненко разработали концепцию расследования этих проблем. Главное — рассматривать сюжеты, в центре которых находится одна из трёх составляющих медиаэкосистемы: аудитория, создатели контента или алгоритм.

1. Расследование того, как аудитория взаимодействует с алгоритмическими лентами

Для начала журналист может сосредоточиться на аудитории — пользователях социальных медиа. Чаще всего это доверчивые люди, использующие социальные медиа, чтобы общаться с друзьями или потреблять новости и получать информацию.

Как мы уже обсуждали ранее, опыт столкновения с дезинформацией или мизинформацией глубоко индивидуален. Чтобы погрузиться в искажённые мировоззрения, сформированные алгоритмами и новостными лентами, журналисты могли бы сосредоточиться на данных о том, что видит в интернете конкретный пользователь — по сути, создать «количественное селфи» опыта одного человека в социальной сети.

Такой подход предполагает запрос на доступ к данным человека, чтобы исследовать, как он пользуется социальными сетями. Благодаря Общему регламенту ЕС о защите данных (General Data Protection Regulation, GDPR) многие компании, работающие в сфере социальных медиа на территории ЕС, в частности, TikTok, Meta и X, обязаны предоставлять пользователям больший контроль над собственными данными, а именно — разрешать им просматривать, загружать и удалять данные о своей онлайн-активности.

К примеру, в этой статье для Documented репортер Малик Гай собрал архивы TikTok-просмотров пяти мигрантов из Сенегала, на решение которых переехать в США отчасти повлияла информация, которую они нашли в TikTok. Эти мигранты в значительной степени полагались на TikTok как источник информации на родном языке. Благодаря архиву журналист увидел, что мигранты просматривали многие видео, которые предоставляли им неточную или вводящую в заблуждение информацию об иммиграционных процессах. Например, некоторые видео давали ошибочные инструкции по заполнению заявления о предоставлении убежища, соблюдение которых могло бы отрицательно сказаться на их иммиграционном деле. Другое видео ошибочно утверждало, что мэр Нью-Йорка распределяет 50 миллионов долларов США среди мигрантов. ByteDance — компания, владеющая TikTok, — не ответила на запрос о комментарии.

Подобным образом журналисты исследовали разрушительное влияние социальных сетей на психическое здоровье молодых женщин. Журналистка NBC News Кэт Тенбарж обнаружила на X несколько групп с пропагандой расстройств пищевого поведения, и эти группы насчитывали от 2 000 до 173 000 пользователей — некоторые участники этих сообществ указывали в профиле, что им 13 лет. Согласно заявлению, предоставленному новостям NBC: «X запрещает контент, пропагандирующий или поощряющий самоповреждение, и имеет нулевую толерантность к сексуальной эксплуатации детей. В этом случае после тщательного разбирательства мы приостановили работу Сообщества за нарушение наших Правил».

Документальный фильм 2025 года «Не отвести взгляд: дело против соцсетей» (Can’t Look Away) рассказывает об обличителях, ранее работавших в Facebook, TikTok и Instagram. Лента исследует, как алгоритмы могут наносить вред из-за способа подачи контента — особенно молодым людям. Обсуждая фильм и свою работу в TikTok Чарльз Бар, один из обличителей, отметил: алгоритмы оптимизируют всё без эмоционального интеллекта — именно это наносит ущерб пользователям. Он рассказал, как TikTok целенаправленно показывал контент, на который пользователи тратили больше времени, в отличие от того, что они сами искали. Другими словами, если пользователь просматривает депрессивное видео, его лента очень быстро превращается в «эхокамеру» подобного контента. ТikTok утверждает, что предлагает «защитные инструменты для младшей аудитории, способы управления экранным временем, инструменты безопасности для родителей и опекунов, а также другие подобные ресурсы».

Артуро Бехар, другой обличитель, работавший в Facebook и Instagram, отметил: компании любят «притворяться», что пользователи якобы могут контролировать нежелательный контент в своей ленте с помощью кнопки «Не интересует». Однако эти средства контроля неэффективны — алгоритм всё равно преимущественно показывает пользователям тот контент, на просмотр которого они тратят больше времени. В то же время, Meta утверждает, что «ввела более 30 функций для улучшения опыта подростков на своих платформах».

Чарльз Бар также отметил: если проблему, с которой сталкиваются пользователи на платформе, легко воспроизвести, особенно когда речь идёт о жутком или травмирующем контенте, это свидетельствует о её системном характере. Так что журналисты могут попытаться прибегнуть к обратному инжинирингу своей ленты: начать больше взаимодействовать с определённым типом контента и посмотреть, как это повлияет на наполнение их ленты. Это поможет понять, как подобный опыт влияет на других пользователей.

«Главное»: хто стаіць за найбольшай сеткай рэгіянальных тэлеграм-каналаў Беларусі

2. Расследование того, как создатели контента эксплуатируют алгоритмы для усиления вредной или ложной информации

Если вы решили расследовать деятельность проблемных создателей контента, следует обратить внимание на фейковый или вводящий в заблуждение вирусный контент и проследить его происхождение.

Многие злоумышленники, проводящие дезинформационные кампании, снова и снова публикуют тот же ложный или вводящий в заблуждение контент на разных платформах.

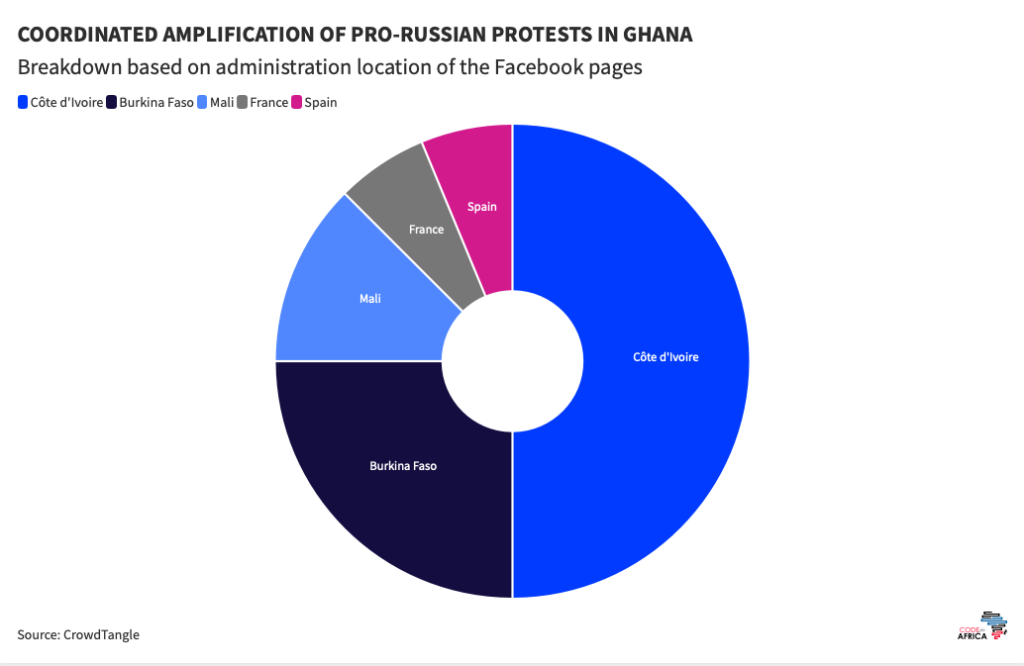

В материале Code for Africa журналисты обнаружили, что сеть из 16 Facebook-аккаунтов, не связанных с Ганой, снова и снова копипастила одно и то же сообщение — систематически распространяя дезинформацию о якобы арестах пророссийских протестующих в стране. Как установили журналисты, эти аккаунты были зарегистрированы в Кот‑д’Ивуаре, Буркина-Фасо, Мали, Франции и Испании.

В другом материале журналисты швейцарского общественного вещателя Schweizer Radio und Fernsehen (SRF) использовали машинное обучение для обнаружения фейковых аккаунтов. Они приобрели 5 000 фейковых аккаунтов, научили свою модель машинного обучения на основе характеристик этих аккаунтов, а затем с помощью этой обученной модели обнаружили другие фейковые аккаунты.

В расследовании пророссийской кампании влияния в Гане журналисты Code for Africa установили, из каких стран «работали» различные аккаунты, распространявшие дезинформацию. Изображение: Code for Africa

3. Расследование того, как работают алгоритмы

Ещё один подход — писать об алгоритмах, влияющих на большинство социальных медиа.

Такие материалы исследуют систему, которая управляет значительной частью нашего онлайн-опыта, в частности влияние алгоритмов на распространение информации или доступ к возможностям.

Однако исследовать и проводить аудит алгоритмов социальных сетей чрезвычайно сложно — это непрозрачные, запутанные системы, трудные для понимания и недоступные для широкой общественности. Например, по данным The Washington Post, Facebook обрабатывает более 10 000 различных сигналов, чтобы предугадать, будет ли человек взаимодействовать с определённой публикацией.

Это значит, что журналистам часто приходится прибегать к обратному инжинирингу — реконструировать принцип работы алгоритмов с помощью сбора данных и экспериментов с тестовыми аккаунтами. Например, The Wall Street Journal создал 100 аккаунтов в ТиkTok, чтобы проверить, какое влияние на контент в лентах этих аккаунтов имели различные действия — от задержки на публикации до повторного просмотра видео.

Но не каждому необходим высокотехнологичный подход к исследованию технологий. Журналисту не всегда нужно объяснять, как работает система. Иногда достаточно найти слабое место и показать, что система наносит вред пользователям.

Для этого материала ProPublica репортёры создали рекламный аккаунт на Facebook и обнаружили, что платформа не мешала им размещать дискриминационную рекламу, которая исключала определённых людей по признаку расы, пола и других персональных характеристик. Показав, что им удалось найти способы обойти закон, они доказали: Facebook не смог предотвратить ущерб. Facebook сообщил ProPublica, что запрещает рекламодателям использовать его услуги в дискриминационных целях.

Алгоритм ненависти. Как социальные сети приводят к радикализации общества

Расследование того, как компании социальных медиа не способны нейтрализовать ущерб от алгоритмов

Полезно также попытаться углубиться во внутренние механизмы работы компаний, управляющих социальными сетями. Журналисты могут это сделать, налаживая контакты с нынешними и бывшими сотрудниками таких компаний, исследуя судебные иски против них или сотрудничая с обличителями. Например, репортёрка Insider Текендра Пармар расследовала смерть Меарега Амаре — эфиопского профессора, убитого после распространения на Facebook ненавистнического и фейкового контента о нём. Пармар пообщалась с несколькими людьми, которые сотрудничали с Facebook в рамках программы «Доверенные партнёры» — сети организаций гражданского общества, которые обладали необходимыми языковыми и культурными знаниями для выявления языка вражды, и сообщали о нём компании. Шестеро участников программы рассказали Пармар, что Facebook «систематически игнорировал их предупреждения о ненавистническом контенте» — в частности, предупреждение о распространявшейся против Амаре дезинформации. Они также позволили журналистке пересмотреть их переписку с компанией. Meta, материнская компания Facebook, сообщила Insider: компания стремилась как можно скорее проверять контент от «Доверенных партнёров», однако время разбирательства может различаться в зависимости от случая.

Эти примеры показывают: есть разные журналистские подходы, которые можно применять в расследованиях деятельности социальных медиа. Среди них высокотехнологичные методы: скрейпинг данных с платформ для анализа или использования цифровой криминалистики для отслеживания злоумышленников. Но журналисты также могут добиться успеха и с помощью низкотехнологичных решений — например, интервью с людьми, которые понесли ущерб на платформах, или проведение экспериментов для подтверждения вредных последствий работы алгоритмов. Поскольку это активно развивающаяся отрасль, ключом к успешным расследованиям алгоритмов социальных сетей является творческий подход.

Дополнительная литература

Инструменты для журналистов

- Алгоритмическая грамотность для журналистов — практический набор инструментов, помогающий журналистам и редакциям понять алгоритмы. Те же исследователи также написали краткое руководство по проведению самостоятельного аудита алгоритмов.

- Indicator — информационный бюллетень экспертов по вопросам дезинформации и фейковых новостей Крейга Сильвермана и Алексиоса Манцарлиса.

- Bellingcat — организация, которая проводит масштабную работу по верификации в сфере социальных медиа и публикует много полезных пособий.

- Статья GIJN «Новые инструменты расследований для мониторинга социальных сетей».

- Майнинг соцсетей — книга о сборе и анализе данных из социальных сетей с помощью языка программирования Python.

- «Алгоритмы: ракурсы и методы расследования» – раздел из «Руководства по журналистике данных».

Исследования

- Algorithmic Justice League — организация, документирующая и исследующая ущерб, причинённый алгоритмами.

- AI Now Institute — независимый институт, публикующий исследования об искусственном интеллекте и алгоритмической подотчётности.

- Center for Democracy and Technology — некоммерческая организация, публикующая отчёты о гражданских свободах в цифровую эпоху.

- Data and Society — некоммерческая исследовательская организация, фокусирующая внимание на технологиях, данных и политике.

- Algorithm Watch — некоммерческая организация, базирующаяся в Цюрихе и Берлине, изучающая влияние алгоритмов на правосудие, права человека, демократию и устойчивое развитие.

@bajmedia

@bajmedia